En este tutorial, aprenderá a usar Python con Redis (pronunciado RED-iss, o tal vez REE-diss o Red-DEES, según a quién le pregunte), que es un almacén de clave-valor en memoria ultrarrápido que se puede usar para cualquier cosa, desde la A hasta la Z. Esto es lo que Siete bases de datos en siete semanas , un libro popular sobre bases de datos, tiene que decir sobre Redis:

No es simplemente fácil de usar; es una alegría Si una API es UX para programadores, entonces Redis debería estar en el Museo de Arte Moderno junto con Mac Cube.

…

Y cuando se trata de velocidad, Redis es difícil de superar. Las lecturas son rápidas y las escrituras son aún más rápidas, manejando más de 100,000 SET operaciones por segundo por algunos puntos de referencia. (Fuente)

¿Intrigado? Este tutorial está diseñado para el programador de Python que puede tener cero o poca experiencia en Redis. Abordaremos dos herramientas a la vez y presentaremos tanto Redis como una de sus bibliotecas cliente de Python, redis-py. .

redis-py (que importa solo como redis ) es uno de los muchos clientes de Python para Redis, pero tiene la distinción de ser catalogado como "actualmente el camino a seguir para Python" por los propios desarrolladores de Redis. Le permite llamar a los comandos de Redis desde Python y recuperar objetos de Python familiares a cambio.

En este tutorial, cubrirá :

- Instalar Redis desde la fuente y comprender el propósito de los archivos binarios resultantes

- Aprender una porción del tamaño de un bocado de Redis, incluida su sintaxis, protocolo y diseño

- Dominar

redis-pyal mismo tiempo que ve destellos de cómo implementa el protocolo de Redis - Configuración y comunicación con una instancia de servidor de Amazon ElastiCache Redis

Descarga gratuita: Obtenga un capítulo de muestra de Python Tricks:The Book que le muestra las mejores prácticas de Python con ejemplos simples que puede aplicar instantáneamente para escribir un código Pythonic más hermoso.

Instalación de Redis desde la fuente

Como dijo mi tatarabuelo, nada genera más valor que instalar desde la fuente. Esta sección lo guiará a través de la descarga, creación e instalación de Redis. ¡Te prometo que esto no dolerá ni un poco!

Nota :Esta sección está orientada a la instalación en Mac OS X o Linux. Si está utilizando Windows, hay una bifurcación de Redis de Microsoft que se puede instalar como un servicio de Windows. Baste decir que Redis como programa vive más cómodamente en una caja de Linux y que la configuración y el uso en Windows pueden ser complicados.

Primero, descargue el código fuente de Redis como un tarball:

$ redisurl="https://download.redis.io/redis-stable.tar.gz"

$ curl -s -o redis-stable.tar.gz $redisurl

A continuación, cambie a root y extraiga el código fuente del archivo a /usr/local/lib/ :

$ sudo su root

$ mkdir -p /usr/local/lib/

$ chmod a+w /usr/local/lib/

$ tar -C /usr/local/lib/ -xzf redis-stable.tar.gz

Opcionalmente, ahora puede eliminar el archivo en sí:

$ rm redis-stable.tar.gz

Esto le dejará con un repositorio de código fuente en /usr/local/lib/redis-stable/ . Redis está escrito en C, por lo que deberá compilar, vincular e instalar con make utilidad:

$ cd /usr/local/lib/redis-stable/

$ make && make install

Usando make install realiza dos acciones:

-

El primer

makeEl comando compila y vincula el código fuente. -

El

make installpart toma los binarios y los copia en/usr/local/bin/para que pueda ejecutarlos desde cualquier lugar (suponiendo que/usr/local/bin/está enPATH).

Aquí están todos los pasos hasta ahora:

$ redisurl="https://download.redis.io/redis-stable.tar.gz"

$ curl -s -o redis-stable.tar.gz $redisurl

$ sudo su root

$ mkdir -p /usr/local/lib/

$ chmod a+w /usr/local/lib/

$ tar -C /usr/local/lib/ -xzf redis-stable.tar.gz

$ rm redis-stable.tar.gz

$ cd /usr/local/lib/redis-stable/

$ make && make install

En este punto, tómese un momento para confirmar que Redis está en su PATH y comprueba su versión:

$ redis-cli --version

redis-cli 5.0.3

Si su shell no puede encontrar redis-cli , asegúrese de que /usr/local/bin/ está en tu PATH variable de entorno, y agréguela si no.

Además de redis-cli , make install en realidad conduce a que se coloquen varios archivos ejecutables diferentes (y un enlace simbólico) en /usr/local/bin/ :

$ # A snapshot of executables that come bundled with Redis

$ ls -hFG /usr/local/bin/redis-* | sort

/usr/local/bin/redis-benchmark*

/usr/local/bin/redis-check-aof*

/usr/local/bin/redis-check-rdb*

/usr/local/bin/redis-cli*

/usr/local/bin/redis-sentinel@

/usr/local/bin/redis-server*

Si bien todos estos tienen algún uso previsto, los dos que probablemente le interesen más son redis-cli y redis-server , que describiremos en breve. Pero antes de llegar a eso, es necesario establecer una configuración básica.

Configuración de Redis

Redis es altamente configurable. Si bien funciona bien desde el primer momento, tomemos un minuto para establecer algunas opciones básicas de configuración que se relacionan con la persistencia de la base de datos y la seguridad básica:

$ sudo su root

$ mkdir -p /etc/redis/

$ touch /etc/redis/6379.conf

Ahora, escribe lo siguiente en /etc/redis/6379.conf . Cubriremos lo que la mayoría de estos significan gradualmente a lo largo del tutorial:

# /etc/redis/6379.conf

port 6379

daemonize yes

save 60 1

bind 127.0.0.1

tcp-keepalive 300

dbfilename dump.rdb

dir ./

rdbcompression yes

La configuración de Redis se autodocumenta, con el ejemplo redis.conf archivo ubicado en la fuente de Redis para su placer de lectura. Si usa Redis en un sistema de producción, vale la pena bloquear todas las distracciones y tomarse el tiempo de leer este archivo de muestra completo para familiarizarse con los entresijos de Redis y ajustar su configuración.

Algunos tutoriales, incluidas partes de la documentación de Redis, también pueden sugerir ejecutar el script de Shell install_server.sh ubicado en redis/utils/install_server.sh . Le invitamos a ejecutar esto como una alternativa más completa a la anterior, pero tome nota de algunos puntos más finos sobre install_server.sh :

- No funcionará en Mac OS X, solo en Debian y Ubuntu Linux.

- Inyectará un conjunto más completo de opciones de configuración en

/etc/redis/6379.conf. - Escribirá un System V

initsecuencia de comandos a/etc/init.d/redis_6379eso te permitirá hacersudo service redis_6379 start.

La guía de inicio rápido de Redis también contiene una sección sobre una configuración de Redis más adecuada, pero las opciones de configuración anteriores deberían ser totalmente suficientes para este tutorial y para comenzar.

Nota de seguridad: Hace unos años, el autor de Redis señaló vulnerabilidades de seguridad en versiones anteriores de Redis si no se establecía ninguna configuración. Redis 3.2 (la versión actual 5.0.3 a partir de marzo de 2019) tomó medidas para evitar esta intrusión, configurando el protected-mode opción a yes por defecto.

Configuramos explícitamente bind 127.0.0.1 para permitir que Redis escuche las conexiones solo desde la interfaz localhost, aunque necesitaría expandir esta lista blanca en un servidor de producción real. El punto de protected-mode es como una medida de seguridad que imitará este comportamiento de vinculación a localhost si no especifica nada debajo de bind opción.

Con eso solucionado, ahora podemos profundizar en el uso de Redis.

Diez minutos más o menos para Redis

Esta sección le brindará el conocimiento suficiente de Redis para que sea peligroso, describiendo su diseño y uso básico.

Cómo empezar

Redis tiene una arquitectura cliente-servidor y utiliza un modelo de solicitud-respuesta . Esto significa que usted (el cliente) se conecta a un servidor Redis a través de una conexión TCP, en el puerto 6379 de forma predeterminada. Solicita alguna acción (como alguna forma de lectura, escritura, obtención, configuración o actualización) y el servidor sirve respaldas una respuesta.

Puede haber muchos clientes hablando con el mismo servidor, que es realmente de lo que se trata Redis o cualquier aplicación cliente-servidor. Cada cliente realiza una lectura (normalmente de bloqueo) en un socket en espera de la respuesta del servidor.

El cli en redis-cli significa interfaz de línea de comandos y el server en redis-server es para, bueno, ejecutar un servidor. De la misma manera que ejecutaría python en la línea de comandos, puede ejecutar redis-cli para saltar a un REPL interactivo (Read Eval Print Loop) donde puede ejecutar los comandos del cliente directamente desde el shell.

Sin embargo, primero deberá iniciar redis-server para que tenga un servidor Redis en ejecución para hablar. Una forma común de hacer esto en desarrollo es iniciar un servidor en localhost (dirección IPv4 127.0.0.1 ), que es el valor predeterminado a menos que le indique lo contrario a Redis. También puede pasar redis-server el nombre de su archivo de configuración, que es similar a especificar todos sus pares clave-valor como argumentos de línea de comandos:

$ redis-server /etc/redis/6379.conf

31829:C 07 Mar 2019 08:45:04.030 # oO0OoO0OoO0Oo Redis is starting oO0OoO0OoO0Oo

31829:C 07 Mar 2019 08:45:04.030 # Redis version=5.0.3, bits=64, commit=00000000, modified=0, pid=31829, just started

31829:C 07 Mar 2019 08:45:04.030 # Configuration loaded

Configuramos el daemonize opción de configuración a yes , por lo que el servidor se ejecuta en segundo plano. (De lo contrario, use --daemonize yes como una opción para redis-server .)

Ahora está listo para iniciar Redis REPL. Introduzca redis-cli en su línea de comando. Verá el host:puerto del servidor par seguido de un > aviso:

127.0.0.1:6379>

Este es uno de los comandos Redis más simples, PING , que solo prueba la conectividad con el servidor y devuelve "PONG" si las cosas están bien:

127.0.0.1:6379> PING

PONG

Los comandos de Redis no distinguen entre mayúsculas y minúsculas, aunque sus contrapartes de Python definitivamente no lo hacen.

pgrep :

$ pgrep redis-server

26983

Para eliminar el servidor, use pkill redis-server desde la línea de comandos. En Mac OS X, también puede usar redis-cli shutdown .

A continuación, usaremos algunos de los comandos comunes de Redis y los compararemos con cómo se verían en Python puro.

Redis como diccionario de Python

Redis significa Servicio de Diccionario Remoto .

"¿Quieres decir, como un diccionario de Python?" puedes preguntar.

Sí. En términos generales, hay muchos paralelismos que se pueden establecer entre un diccionario de Python (o una tabla hash genérica) y lo que Redis es y hace:

-

Una base de datos de Redis contiene key:value empareja y admite comandos como

GET,SETyDEL, así como varios cientos de comandos adicionales. -

Redis claves son siempre cadenas.

-

Redis valores puede haber varios tipos de datos diferentes. Cubriremos algunos de los tipos de datos de valor más esenciales en este tutorial:

string,list,hashesysets. Algunos tipos avanzados incluyen elementos geoespaciales y el nuevo tipo de transmisión. -

Muchos comandos de Redis funcionan en tiempo O(1) constante, al igual que recuperar un valor de un Python

dicto cualquier tabla hash.

Al creador de Redis, Salvatore Sanfilippo, probablemente no le encantaría comparar una base de datos de Redis con un dict de Python simple y sencillo. . Él llama al proyecto un "servidor de estructura de datos" (en lugar de un almacén de clave-valor, como Memcached) porque, en su favor, Redis admite el almacenamiento de tipos adicionales de clave:valor. tipos de datos además de string:string . Pero para nuestros propósitos aquí, es una comparación útil si está familiarizado con el objeto de diccionario de Python.

Entremos y aprendamos con el ejemplo. Nuestra primera base de datos de juguetes (con ID 0) será un mapeo de país:ciudad capital , donde usamos SET para establecer pares clave-valor:

127.0.0.1:6379> SET Bahamas Nassau

OK

127.0.0.1:6379> SET Croatia Zagreb

OK

127.0.0.1:6379> GET Croatia

"Zagreb"

127.0.0.1:6379> GET Japan

(nil)

La secuencia correspondiente de declaraciones en Python puro se vería así:

>>>>>> capitals = {}

>>> capitals["Bahamas"] = "Nassau"

>>> capitals["Croatia"] = "Zagreb"

>>> capitals.get("Croatia")

'Zagreb'

>>> capitals.get("Japan") # None

Usamos capitals.get("Japan") en lugar de capitals["Japan"] porque Redis devolverá nil en lugar de un error cuando no se encuentra una clave, que es análogo a None de Python .

Redis también le permite configurar y obtener múltiples pares clave-valor en un solo comando, MSET y MGET , respectivamente:

127.0.0.1:6379> MSET Lebanon Beirut Norway Oslo France Paris

OK

127.0.0.1:6379> MGET Lebanon Norway Bahamas

1) "Beirut"

2) "Oslo"

3) "Nassau"

Lo más parecido en Python es con dict.update() :

>>> capitals.update({

... "Lebanon": "Beirut",

... "Norway": "Oslo",

... "France": "Paris",

... })

>>> [capitals.get(k) for k in ("Lebanon", "Norway", "Bahamas")]

['Beirut', 'Oslo', 'Nassau']

Usamos .get() en lugar de .__getitem__() para imitar el comportamiento de Redis de devolver un valor nulo cuando no se encuentra ninguna clave.

Como tercer ejemplo, EXISTS El comando hace lo que parece, que es comprobar si existe una clave:

127.0.0.1:6379> EXISTS Norway

(integer) 1

127.0.0.1:6379> EXISTS Sweden

(integer) 0

Python tiene el in palabra clave para probar lo mismo, que se enruta a dict.__contains__(key) :

>>> "Norway" in capitals

True

>>> "Sweden" in capitals

False

Estos pocos ejemplos están destinados a mostrar, utilizando Python nativo, lo que sucede a un alto nivel con algunos comandos comunes de Redis. No hay un componente cliente-servidor aquí para los ejemplos de Python, y redis-py aún no ha entrado en escena. Esto solo pretende mostrar la funcionalidad de Redis con un ejemplo.

Este es un resumen de los pocos comandos de Redis que ha visto y sus equivalentes funcionales de Python:

capitals["Bahamas"] = "Nassau"

capitals.get("Croatia")

capitals.update(

{

"Lebanon": "Beirut",

"Norway": "Oslo",

"France": "Paris",

}

)

[capitals[k] for k in ("Lebanon", "Norway", "Bahamas")]

"Norway" in capitals

La biblioteca cliente de Python Redis, redis-py , en el que se sumergirá en breve en este artículo, hace las cosas de manera diferente. Encapsula una conexión TCP real a un servidor Redis y envía comandos sin procesar, como bytes serializados mediante el protocolo de serialización REdis (RESP), al servidor. Luego toma la respuesta sin procesar y la vuelve a analizar en un objeto de Python como bytes , int , o incluso datetime.datetime .

Nota :Hasta ahora, ha estado hablando con el servidor de Redis a través del redis-cli interactivo. REEMPLAZAR También puede emitir comandos directamente, de la misma manera que pasaría el nombre de un script a python ejecutable, como python myscript.py .

Hasta ahora, ha visto algunos de los tipos de datos fundamentales de Redis, que es un mapeo de cadena:cadena . Si bien este par clave-valor es común en la mayoría de las tiendas clave-valor, Redis ofrece otros tipos de valores posibles, que verá a continuación.

Más tipos de datos en Python frente a Redis

Antes de iniciar redis-py Cliente de Python, también ayuda tener una comprensión básica de algunos tipos de datos de Redis más. Para ser claros, todas las claves de Redis son cadenas. Es el valor que puede tomar tipos de datos (o estructuras) además de los valores de cadena utilizados en los ejemplos hasta ahora.

Un hachís es un mapeo de string:string , llamado valor-campo pares, que se encuentra bajo una clave de nivel superior:

127.0.0.1:6379> HSET realpython url "https://realpython.com/"

(integer) 1

127.0.0.1:6379> HSET realpython github realpython

(integer) 1

127.0.0.1:6379> HSET realpython fullname "Real Python"

(integer) 1

Esto establece tres pares de valores de campo para una clave , "realpython" . Si está acostumbrado a la terminología y los objetos de Python, esto puede resultar confuso. Un hash de Redis es más o menos análogo a un Python dict que está anidado un nivel de profundidad:

data = {

"realpython": {

"url": "https://realpython.com/",

"github": "realpython",

"fullname": "Real Python",

}

}

Los campos de Redis son similares a las claves de Python de cada par clave-valor anidado en el diccionario interno anterior. Redis se reserva el término clave para la clave de la base de datos de nivel superior que contiene la estructura hash.

Al igual que hay MSET para cadena:cadena básico pares clave-valor, también hay HMSET para hashes para establecer varios pares dentro el objeto de valor hash:

127.0.0.1:6379> HMSET pypa url "https://www.pypa.io/" github pypa fullname "Python Packaging Authority"

OK

127.0.0.1:6379> HGETALL pypa

1) "url"

2) "https://www.pypa.io/"

3) "github"

4) "pypa"

5) "fullname"

6) "Python Packaging Authority"

Usando HMSET es probablemente un paralelo más cercano a la forma en que asignamos data a un diccionario anidado arriba, en lugar de configurar cada par anidado como se hace con HSET .

Dos tipos de valores adicionales son listas y conjuntos , que puede tomar el lugar de un hash o una cadena como valor de Redis. Son en gran medida lo que parecen, por lo que no le quitaré el tiempo con ejemplos adicionales. Los hashes, las listas y los conjuntos tienen cada uno algunos comandos que son particulares de ese tipo de datos dado, que en algunos casos se indican con su letra inicial:

-

Hashes: Los comandos para operar en hashes comienzan con un

H, comoHSET,HGEToHMSET. -

Conjuntos: Los comandos para operar en conjuntos comienzan con un

S, comoSCARD, que obtiene el número de elementos en el valor establecido correspondiente a una clave determinada. -

Listas: Los comandos para operar en listas comienzan con

LoR. Los ejemplos incluyenLPOPyRPUSH. ElLoRse refiere a qué lado de la lista se opera. Algunos comandos de lista también están precedidos por unB, lo que significa bloquear . Una operación de bloqueo no permite que otras operaciones la interrumpan mientras se ejecuta. Por ejemplo,BLPOPejecuta una ventana emergente de bloqueo en una estructura de lista.

Aquí hay una lista rápida de comandos que son específicos para los tipos de datos de cadena, hash, lista y conjunto en Redis:

| Tipo | Comandos |

|---|---|

| Conjuntos | SADD , SCARD , SDIFF , SDIFFSTORE , SINTER , SINTERSTORE , SISMEMBER , SMEMBERS , SMOVE , SPOP , SRANDMEMBER , SREM , SSCAN , SUNION , SUNIONSTORE |

| Hashes | HDEL , HEXISTS , HGET , HGETALL , HINCRBY , HINCRBYFLOAT , HKEYS , HLEN , HMGET , HMSET , HSCAN , HSET , HSETNX , HSTRLEN , HVALS |

| Listas | BLPOP , BRPOP , BRPOPLPUSH , LINDEX , LINSERT , LLEN , LPOP , LPUSH , LPUSHX , LRANGE , LREM , LSET , LTRIM , RPOP , RPOPLPUSH , RPUSH , RPUSHX |

| Cuerdas | APPEND , BITCOUNT , BITFIELD , BITOP , BITPOS , DECR , DECRBY , GET , GETBIT , GETRANGE , GETSET , INCR , INCRBY , INCRBYFLOAT , MGET , MSET , MSETNX , PSETEX , SET , SETBIT , SETEX , SETNX , SETRANGE , STRLEN |

Esta tabla no es una imagen completa de los comandos y tipos de Redis. Hay una mezcla heterogénea de tipos de datos más avanzados, como elementos geoespaciales, conjuntos ordenados e HyperLogLog. En la página de comandos de Redis, puede filtrar por grupo de estructura de datos. También está el resumen de los tipos de datos y la introducción a los tipos de datos de Redis.

Como vamos a cambiar para hacer las cosas en Python, ahora puede borrar su base de datos de juguetes con FLUSHDB y salga del redis-cli REEMPLAZAR:

127.0.0.1:6379> FLUSHDB

OK

127.0.0.1:6379> QUIT

Esto lo llevará de regreso a su indicador de shell. Puedes dejar redis-server ejecutándose en segundo plano, ya que también lo necesitará para el resto del tutorial.

Usando redis-py :Redis en Python

Ahora que domina algunos conceptos básicos de Redis, es hora de saltar a redis-py , el cliente de Python que le permite hablar con Redis desde una API de Python fácil de usar.

Primeros pasos

redis-py es una biblioteca de cliente de Python bien establecida que le permite comunicarse con un servidor de Redis directamente a través de llamadas de Python:

$ python -m pip install redis

A continuación, asegúrese de que su servidor Redis todavía esté funcionando en segundo plano. Puede verificar con pgrep redis-server , y si se queda con las manos vacías, reinicie un servidor local con redis-server /etc/redis/6379.conf .

Ahora, entremos en la parte centrada en Python de las cosas. Aquí está el "hola mundo" de redis-py :

1>>> import redis

2>>> r = redis.Redis()

3>>> r.mset({"Croatia": "Zagreb", "Bahamas": "Nassau"})

4True

5>>> r.get("Bahamas")

6b'Nassau'

Redis , utilizado en la línea 2, es la clase central del paquete y el caballo de batalla con el que ejecuta (casi) cualquier comando de Redis. La conexión y reutilización del socket TCP se realiza detrás de escena, y usted llama a los comandos de Redis usando métodos en la instancia de clase r .

Observe también que el tipo del objeto devuelto, b'Nassau' en la línea 6, son los bytes de Python tipo, no str . Es bytes en lugar de str ese es el tipo de devolución más común en redis-py , por lo que es posible que deba llamar a r.get("Bahamas").decode("utf-8") dependiendo de lo que quiera hacer realmente con la cadena de bytes devuelta.

¿Te resulta familiar el código anterior? Los métodos en casi todos los casos coinciden con el nombre del comando Redis que hace lo mismo. Aquí, llamaste a r.mset() y r.get() , que corresponden a MSET y GET en la API nativa de Redis.

Esto también significa que HGETALL se convierte en r.hgetall() , PING se convierte en r.ping() , y así. Hay algunas excepciones, pero la regla se cumple para la gran mayoría de los comandos.

Si bien los argumentos del comando Redis generalmente se traducen en una firma de método de aspecto similar, toman objetos de Python. Por ejemplo, la llamada a r.mset() en el ejemplo anterior usa Python dict como su primer argumento, en lugar de una secuencia de cadenas de bytes.

Construimos el Redis instancia r sin argumentos, pero viene con una serie de parámetros si los necesita:

# From redis/client.py

class Redis(object):

def __init__(self, host='localhost', port=6379,

db=0, password=None, socket_timeout=None,

# ...

Puede ver que el hostname:port predeterminado el par es localhost:6379 , que es exactamente lo que necesitamos en el caso de nuestro redis-server guardado localmente instancia.

El db el parámetro es el número de la base de datos. Puede administrar varias bases de datos en Redis a la vez, y cada una se identifica con un número entero. El número máximo de bases de datos es 16 de forma predeterminada.

Cuando ejecuta solo redis-cli desde la línea de comando, esto lo inicia en la base de datos 0. Use -n bandera para iniciar una nueva base de datos, como en redis-cli -n 5 .

Tipos de clave permitidos

Una cosa que vale la pena saber es que redis-py requiere que le pases claves que sean bytes , str , int , o float . (Convertirá los últimos 3 de estos tipos a bytes antes de enviarlos al servidor).

Considere un caso en el que desee utilizar las fechas del calendario como claves:

>>>>>> import datetime

>>> today = datetime.date.today()

>>> visitors = {"dan", "jon", "alex"}

>>> r.sadd(today, *visitors)

Traceback (most recent call last):

# ...

redis.exceptions.DataError: Invalid input of type: 'date'.

Convert to a byte, string or number first.

Deberá convertir explícitamente la date de Python objeto a str , que puedes hacer con .isoformat() :

>>> stoday = today.isoformat() # Python 3.7+, or use str(today)

>>> stoday

'2019-03-10'

>>> r.sadd(stoday, *visitors) # sadd: set-add

3

>>> r.smembers(stoday)

{b'dan', b'alex', b'jon'}

>>> r.scard(today.isoformat())

3

En resumen, Redis en sí solo permite cadenas como claves. redis-py es un poco más liberal en cuanto a los tipos de Python que aceptará, aunque finalmente convierte todo a bytes antes de enviarlos a un servidor Redis.

Ejemplo:PyHats.com

Es hora de sacar un ejemplo más completo. Supongamos que hemos decidido iniciar un sitio web lucrativo, PyHats.com, que vende sombreros a un precio escandaloso a cualquiera que los compre, y te contratamos para construir el sitio.

Utilizará Redis para gestionar parte del catálogo de productos, el inventario y la detección de tráfico de bots para PyHats.com.

Es el primer día del sitio y vamos a vender tres gorras de edición limitada. Cada sombrero se mantiene en un hash Redis de pares de valores de campo, y el hash tiene una clave que es un número entero aleatorio con prefijo, como hat:56854717 . Usando el hat: El prefijo es una convención de Redis para crear una especie de espacio de nombres dentro de una base de datos de Redis:

import random

random.seed(444)

hats = {f"hat:{random.getrandbits(32)}": i for i in (

{

"color": "black",

"price": 49.99,

"style": "fitted",

"quantity": 1000,

"npurchased": 0,

},

{

"color": "maroon",

"price": 59.99,

"style": "hipster",

"quantity": 500,

"npurchased": 0,

},

{

"color": "green",

"price": 99.99,

"style": "baseball",

"quantity": 200,

"npurchased": 0,

})

}

Comencemos con la base de datos 1 ya que usamos la base de datos 0 en un ejemplo anterior:

>>> r = redis.Redis(db=1)

Para hacer una escritura inicial de estos datos en Redis, podemos usar .hmset() (hash multi-set), llamándolo para cada diccionario. El "multi" es una referencia a la configuración de múltiples pares de campo-valor, donde "campo" en este caso corresponde a una clave de cualquiera de los diccionarios anidados en hats :

1>>> with r.pipeline() as pipe:

2... for h_id, hat in hats.items():

3... pipe.hmset(h_id, hat)

4... pipe.execute()

5Pipeline<ConnectionPool<Connection<host=localhost,port=6379,db=1>>>

6Pipeline<ConnectionPool<Connection<host=localhost,port=6379,db=1>>>

7Pipeline<ConnectionPool<Connection<host=localhost,port=6379,db=1>>>

8[True, True, True]

9

10>>> r.bgsave()

11True

El bloque de código anterior también presenta el concepto de canalización de Redis , que es una forma de reducir la cantidad de transacciones de ida y vuelta que necesita para escribir o leer datos de su servidor Redis. Si hubiera llamado a r.hmset() tres veces, entonces esto requeriría una operación de ida y vuelta de ida y vuelta para cada fila escrita.

Con una canalización, todos los comandos se almacenan en el búfer en el lado del cliente y luego se envían a la vez, de una sola vez, usando pipe.hmset() en la línea 3. Por eso los tres True todas las respuestas se devuelven a la vez, cuando llamas a pipe.execute() en la Línea 4. Verá un caso de uso más avanzado para una canalización en breve.

Nota :Los documentos de Redis proporcionan un ejemplo de cómo hacer lo mismo con redis-cli , donde puede canalizar el contenido de un archivo local para realizar una inserción masiva.

Hagamos una verificación rápida de que todo está allí en nuestra base de datos de Redis:

>>>>>> pprint(r.hgetall("hat:56854717"))

{b'color': b'green',

b'npurchased': b'0',

b'price': b'99.99',

b'quantity': b'200',

b'style': b'baseball'}

>>> r.keys() # Careful on a big DB. keys() is O(N)

[b'56854717', b'1236154736', b'1326692461']

Lo primero que queremos simular es lo que sucede cuando un usuario hace clic en Comprar . Si el artículo está en stock, aumente su npurchased por 1 y disminuir su quantity (inventario) por 1. Puede usar .hincrby() para hacer esto:

>>> r.hincrby("hat:56854717", "quantity", -1)

199

>>> r.hget("hat:56854717", "quantity")

b'199'

>>> r.hincrby("hat:56854717", "npurchased", 1)

1

Nota :HINCRBY aún opera en un valor hash que es una cadena, pero intenta interpretar la cadena como un entero de base 10 de 64 bits con signo para ejecutar la operación.

Esto se aplica a otros comandos relacionados con el incremento y la disminución de otras estructuras de datos, a saber, INCR , INCRBY , INCRBYFLOAT , ZINCRBY y HINCRBYFLOAT . Obtendrá un error si la cadena en el valor no se puede representar como un número entero.

Sin embargo, en realidad no es tan simple. Cambiar la quantity y npurchased en dos líneas de código oculta la realidad de que un clic, una compra y un pago implican más que eso. We need to do a few more checks to make sure we don’t leave someone with a lighter wallet and no hat:

- Step 1: Check if the item is in stock, or otherwise raise an exception on the backend.

- Step 2: If it is in stock, then execute the transaction, decrease the

quantityfield, and increase thenpurchasedfield. - Step 3: Be alert for any changes that alter the inventory in between the first two steps (a race condition).

Step 1 is relatively straightforward:it consists of an .hget() to check the available quantity.

Step 2 is a little bit more involved. The pair of increase and decrease operations need to be executed atomically :either both should be completed successfully, or neither should be (in the case that at least one fails).

With client-server frameworks, it’s always crucial to pay attention to atomicity and look out for what could go wrong in instances where multiple clients are trying to talk to the server at once. The answer to this in Redis is to use a transaction block, meaning that either both or neither of the commands get through.

In redis-py , Pipeline is a transactional pipeline class by default. This means that, even though the class is actually named for something else (pipelining), it can be used to create a transaction block also.

In Redis, a transaction starts with MULTI and ends with EXEC :

1127.0.0.1:6379> MULTI

2127.0.0.1:6379> HINCRBY 56854717 quantity -1

3127.0.0.1:6379> HINCRBY 56854717 npurchased 1

4127.0.0.1:6379> EXEC

MULTI (Line 1) marks the start of the transaction, and EXEC (Line 4) marks the end. Everything in between is executed as one all-or-nothing buffered sequence of commands. This means that it will be impossible to decrement quantity (Line 2) but then have the balancing npurchased increment operation fail (Line 3).

Let’s circle back to Step 3:we need to be aware of any changes that alter the inventory in between the first two steps.

Step 3 is the trickiest. Let’s say that there is one lone hat remaining in our inventory. In between the time that User A checks the quantity of hats remaining and actually processes their transaction, User B also checks the inventory and finds likewise that there is one hat listed in stock. Both users will be allowed to purchase the hat, but we have 1 hat to sell, not 2, so we’re on the hook and one user is out of their money. Not good.

Redis has a clever answer for the dilemma in Step 3:it’s called optimistic locking , and is different than how typical locking works in an RDBMS such as PostgreSQL. Optimistic locking, in a nutshell, means that the calling function (client) does not acquire a lock, but rather monitors for changes in the data it is writing to during the time it would have held a lock . If there’s a conflict during that time, the calling function simply tries the whole process again.

You can effect optimistic locking by using the WATCH command (.watch() in redis-py ), which provides a check-and-set behavior.

Let’s introduce a big chunk of code and walk through it afterwards step by step. You can picture buyitem() as being called any time a user clicks on a Buy Now or Purchase botón. Its purpose is to confirm the item is in stock and take an action based on that result, all in a safe manner that looks out for race conditions and retries if one is detected:

1import logging

2import redis

3

4logging.basicConfig()

5

6class OutOfStockError(Exception):

7 """Raised when PyHats.com is all out of today's hottest hat"""

8

9def buyitem(r: redis.Redis, itemid: int) -> None:

10 with r.pipeline() as pipe:

11 error_count = 0

12 while True:

13 try:

14 # Get available inventory, watching for changes

15 # related to this itemid before the transaction

16 pipe.watch(itemid)

17 nleft: bytes = r.hget(itemid, "quantity")

18 if nleft > b"0":

19 pipe.multi()

20 pipe.hincrby(itemid, "quantity", -1)

21 pipe.hincrby(itemid, "npurchased", 1)

22 pipe.execute()

23 break

24 else:

25 # Stop watching the itemid and raise to break out

26 pipe.unwatch()

27 raise OutOfStockError(

28 f"Sorry, {itemid} is out of stock!"

29 )

30 except redis.WatchError:

31 # Log total num. of errors by this user to buy this item,

32 # then try the same process again of WATCH/HGET/MULTI/EXEC

33 error_count += 1

34 logging.warning(

35 "WatchError #%d: %s; retrying",

36 error_count, itemid

37 )

38 return None

The critical line occurs at Line 16 with pipe.watch(itemid) , which tells Redis to monitor the given itemid for any changes to its value. The program checks the inventory through the call to r.hget(itemid, "quantity") , in Line 17:

16pipe.watch(itemid)

17nleft: bytes = r.hget(itemid, "quantity")

18if nleft > b"0":

19 # Item in stock. Proceed with transaction.

If the inventory gets touched during this short window between when the user checks the item stock and tries to purchase it, then Redis will return an error, and redis-py will raise a WatchError (Line 30). That is, if any of the hash pointed to by itemid changes after the .hget() call but before the subsequent .hincrby() calls in Lines 20 and 21, then we’ll re-run the whole process in another iteration of the while True loop as a result.

This is the “optimistic” part of the locking:rather than letting the client have a time-consuming total lock on the database through the getting and setting operations, we leave it up to Redis to notify the client and user only in the case that calls for a retry of the inventory check.

One key here is in understanding the difference between client-side and server-side operations:

nleft = r.hget(itemid, "quantity")

This Python assignment brings the result of r.hget() client-side. Conversely, methods that you call on pipe effectively buffer all of the commands into one, and then send them to the server in a single request:

16pipe.multi()

17pipe.hincrby(itemid, "quantity", -1)

18pipe.hincrby(itemid, "npurchased", 1)

19pipe.execute()

No data comes back to the client side in the middle of the transactional pipeline. You need to call .execute() (Line 19) to get the sequence of results back all at once.

Even though this block contains two commands, it consists of exactly one round-trip operation from client to server and back.

This means that the client can’t immediately use the result of pipe.hincrby(itemid, "quantity", -1) , from Line 20, because methods on a Pipeline return just the pipe instance itself. We haven’t asked anything from the server at this point. While normally .hincrby() returns the resulting value, you can’t immediately reference it on the client side until the entire transaction is completed.

There’s a catch-22:this is also why you can’t put the call to .hget() into the transaction block. If you did this, then you’d be unable to know if you want to increment the npurchased field yet, since you can’t get real-time results from commands that are inserted into a transactional pipeline.

Finally, if the inventory sits at zero, then we UNWATCH the item ID and raise an OutOfStockError (Line 27), ultimately displaying that coveted Sold Out page that will make our hat buyers desperately want to buy even more of our hats at ever more outlandish prices:

24else:

25 # Stop watching the itemid and raise to break out

26 pipe.unwatch()

27 raise OutOfStockError(

28 f"Sorry, {itemid} is out of stock!"

29 )

Here’s an illustration. Keep in mind that our starting quantity is 199 for hat 56854717 since we called .hincrby() sobre. Let’s mimic 3 purchases, which should modify the quantity and npurchased fields:

>>> buyitem(r, "hat:56854717")

>>> buyitem(r, "hat:56854717")

>>> buyitem(r, "hat:56854717")

>>> r.hmget("hat:56854717", "quantity", "npurchased") # Hash multi-get

[b'196', b'4']

Now, we can fast-forward through more purchases, mimicking a stream of purchases until the stock depletes to zero. Again, picture these coming from a whole bunch of different clients rather than just one Redis instance:

>>> # Buy remaining 196 hats for item 56854717 and deplete stock to 0

>>> for _ in range(196):

... buyitem(r, "hat:56854717")

>>> r.hmget("hat:56854717", "quantity", "npurchased")

[b'0', b'200']

Now, when some poor user is late to the game, they should be met with an OutOfStockError that tells our application to render an error message page on the frontend:

>>> buyitem(r, "hat:56854717")

Traceback (most recent call last):

File "<stdin>", line 1, in <module>

File "<stdin>", line 20, in buyitem

__main__.OutOfStockError: Sorry, hat:56854717 is out of stock!

Looks like it’s time to restock.

Using Key Expiry

Let’s introduce key expiry , which is another distinguishing feature in Redis. When you expire a key, that key and its corresponding value will be automatically deleted from the database after a certain number of seconds or at a certain timestamp.

In redis-py , one way that you can accomplish this is through .setex() , which lets you set a basic string:string key-value pair with an expiration:

1>>> from datetime import timedelta

2

3>>> # setex: "SET" with expiration

4>>> r.setex(

5... "runner",

6... timedelta(minutes=1),

7... value="now you see me, now you don't"

8... )

9True

You can specify the second argument as a number in seconds or a timedelta object, as in Line 6 above. I like the latter because it seems less ambiguous and more deliberate.

There are also methods (and corresponding Redis commands, of course) to get the remaining lifetime (time-to-live ) of a key that you’ve set to expire:

>>>>>> r.ttl("runner") # "Time To Live", in seconds

58

>>> r.pttl("runner") # Like ttl, but milliseconds

54368

Below, you can accelerate the window until expiration, and then watch the key expire, after which r.get() will return None and .exists() will return 0 :

>>> r.get("runner") # Not expired yet

b"now you see me, now you don't"

>>> r.expire("runner", timedelta(seconds=3)) # Set new expire window

True

>>> # Pause for a few seconds

>>> r.get("runner")

>>> r.exists("runner") # Key & value are both gone (expired)

0

The table below summarizes commands related to key-value expiration, including the ones covered above. The explanations are taken directly from redis-py method docstrings:

| Signature | Purpose |

|---|---|

r.setex(name, time, value) | Sets the value of key name to value that expires in time seconds, where time can be represented by an int or a Python timedelta object |

r.psetex(name, time_ms, value) | Sets the value of key name to value that expires in time_ms milliseconds, where time_ms can be represented by an int or a Python timedelta object |

r.expire(name, time) | Sets an expire flag on key name for time seconds, where time can be represented by an int or a Python timedelta object |

r.expireat(name, when) | Sets an expire flag on key name , where when can be represented as an int indicating Unix time or a Python datetime object |

r.persist(name) | Removes an expiration on name |

r.pexpire(name, time) | Sets an expire flag on key name for time milliseconds, and time can be represented by an int or a Python timedelta object |

r.pexpireat(name, when) | Sets an expire flag on key name , where when can be represented as an int representing Unix time in milliseconds (Unix time * 1000) or a Python datetime object |

r.pttl(name) | Returns the number of milliseconds until the key name will expire |

r.ttl(name) | Returns the number of seconds until the key name will expire |

PyHats.com, Part 2

A few days after its debut, PyHats.com has attracted so much hype that some enterprising users are creating bots to buy hundreds of items within seconds, which you’ve decided isn’t good for the long-term health of your hat business.

Now that you’ve seen how to expire keys, let’s put it to use on the backend of PyHats.com.

We’re going to create a new Redis client that acts as a consumer (or watcher) and processes a stream of incoming IP addresses, which in turn may come from multiple HTTPS connections to the website’s server.

The watcher’s goal is to monitor a stream of IP addresses from multiple sources, keeping an eye out for a flood of requests from a single address within a suspiciously short amount of time.

Some middleware on the website server pushes all incoming IP addresses into a Redis list with .lpush() . Here’s a crude way of mimicking some incoming IPs, using a fresh Redis database:

>>> r = redis.Redis(db=5)

>>> r.lpush("ips", "51.218.112.236")

1

>>> r.lpush("ips", "90.213.45.98")

2

>>> r.lpush("ips", "115.215.230.176")

3

>>> r.lpush("ips", "51.218.112.236")

4

As you can see, .lpush() returns the length of the list after the push operation succeeds. Each call of .lpush() puts the IP at the beginning of the Redis list that is keyed by the string "ips" .

In this simplified simulation, the requests are all technically from the same client, but you can think of them as potentially coming from many different clients and all being pushed to the same database on the same Redis server.

Now, open up a new shell tab or window and launch a new Python REPL. In this shell, you’ll create a new client that serves a very different purpose than the rest, which sits in an endless while True loop and does a blocking left-pop BLPOP call on the ips list, processing each address:

1# New shell window or tab

2

3import datetime

4import ipaddress

5

6import redis

7

8# Where we put all the bad egg IP addresses

9blacklist = set()

10MAXVISITS = 15

11

12ipwatcher = redis.Redis(db=5)

13

14while True:

15 _, addr = ipwatcher.blpop("ips")

16 addr = ipaddress.ip_address(addr.decode("utf-8"))

17 now = datetime.datetime.utcnow()

18 addrts = f"{addr}:{now.minute}"

19 n = ipwatcher.incrby(addrts, 1)

20 if n >= MAXVISITS:

21 print(f"Hat bot detected!: {addr}")

22 blacklist.add(addr)

23 else:

24 print(f"{now}: saw {addr}")

25 _ = ipwatcher.expire(addrts, 60)

Let’s walk through a few important concepts.

The ipwatcher acts like a consumer, sitting around and waiting for new IPs to be pushed on the "ips" Redis list. It receives them as bytes , such as b”51.218.112.236”, and makes them into a more proper address object with the ipaddress module:

15_, addr = ipwatcher.blpop("ips")

16addr = ipaddress.ip_address(addr.decode("utf-8"))

Then you form a Redis string key using the address and minute of the hour at which the ipwatcher saw the address, incrementing the corresponding count by 1 and getting the new count in the process:

17now = datetime.datetime.utcnow()

18addrts = f"{addr}:{now.minute}"

19n = ipwatcher.incrby(addrts, 1)

If the address has been seen more than MAXVISITS , then it looks as if we have a PyHats.com web scraper on our hands trying to create the next tulip bubble. Alas, we have no choice but to give this user back something like a dreaded 403 status code.

We use ipwatcher.expire(addrts, 60) to expire the (address minute) combination 60 seconds from when it was last seen. This is to prevent our database from becoming clogged up with stale one-time page viewers.

If you execute this code block in a new shell, you should immediately see this output:

2019-03-11 15:10:41.489214: saw 51.218.112.236

2019-03-11 15:10:41.490298: saw 115.215.230.176

2019-03-11 15:10:41.490839: saw 90.213.45.98

2019-03-11 15:10:41.491387: saw 51.218.112.236

The output appears right away because those four IPs were sitting in the queue-like list keyed by "ips" , waiting to be pulled out by our ipwatcher . Using .blpop() (or the BLPOP command) will block until an item is available in the list, then pops it off. It behaves like Python’s Queue.get() , which also blocks until an item is available.

Besides just spitting out IP addresses, our ipwatcher has a second job. For a given minute of an hour (minute 1 through minute 60), ipwatcher will classify an IP address as a hat-bot if it sends 15 or more GET requests in that minute.

Switch back to your first shell and mimic a page scraper that blasts the site with 20 requests in a few milliseconds:

for _ in range(20):

r.lpush("ips", "104.174.118.18")

Finally, toggle back to the second shell holding ipwatcher , and you should see an output like this:

2019-03-11 15:15:43.041363: saw 104.174.118.18

2019-03-11 15:15:43.042027: saw 104.174.118.18

2019-03-11 15:15:43.042598: saw 104.174.118.18

2019-03-11 15:15:43.043143: saw 104.174.118.18

2019-03-11 15:15:43.043725: saw 104.174.118.18

2019-03-11 15:15:43.044244: saw 104.174.118.18

2019-03-11 15:15:43.044760: saw 104.174.118.18

2019-03-11 15:15:43.045288: saw 104.174.118.18

2019-03-11 15:15:43.045806: saw 104.174.118.18

2019-03-11 15:15:43.046318: saw 104.174.118.18

2019-03-11 15:15:43.046829: saw 104.174.118.18

2019-03-11 15:15:43.047392: saw 104.174.118.18

2019-03-11 15:15:43.047966: saw 104.174.118.18

2019-03-11 15:15:43.048479: saw 104.174.118.18

Hat bot detected!: 104.174.118.18

Hat bot detected!: 104.174.118.18

Hat bot detected!: 104.174.118.18

Hat bot detected!: 104.174.118.18

Hat bot detected!: 104.174.118.18

Hat bot detected!: 104.174.118.18

Now, Ctrl +C out of the while True loop and you’ll see that the offending IP has been added to your blacklist:

>>> blacklist

{IPv4Address('104.174.118.18')}

Can you find the defect in this detection system? The filter checks the minute as .minute rather than the last 60 seconds (a rolling minute). Implementing a rolling check to monitor how many times a user has been seen in the last 60 seconds would be trickier. There’s a crafty solution using using Redis’ sorted sets at ClassDojo. Josiah Carlson’s Redis in Action also presents a more elaborate and general-purpose example of this section using an IP-to-location cache table.

Persistence and Snapshotting

One of the reasons that Redis is so fast in both read and write operations is that the database is held in memory (RAM) on the server. However, a Redis database can also be stored (persisted) to disk in a process called snapshotting. The point behind this is to keep a physical backup in binary format so that data can be reconstructed and put back into memory when needed, such as at server startup.

You already enabled snapshotting without knowing it when you set up basic configuration at the beginning of this tutorial with the save option:

# /etc/redis/6379.conf

port 6379

daemonize yes

save 60 1

bind 127.0.0.1

tcp-keepalive 300

dbfilename dump.rdb

dir ./

rdbcompression yes

The format is save <seconds> <changes> . This tells Redis to save the database to disk if both the given number of seconds and number of write operations against the database occurred. In this case, we’re telling Redis to save the database to disk every 60 seconds if at least one modifying write operation occurred in that 60-second timespan. This is a fairly aggressive setting versus the sample Redis config file, which uses these three save directives:

# Default redis/redis.conf

save 900 1

save 300 10

save 60 10000

An RDB snapshot is a full (rather than incremental) point-in-time capture of the database. (RDB refers to a Redis Database File.) We also specified the directory and file name of the resulting data file that gets written:

# /etc/redis/6379.conf

port 6379

daemonize yes

save 60 1

bind 127.0.0.1

tcp-keepalive 300

dbfilename dump.rdb

dir ./

rdbcompression yes

This instructs Redis to save to a binary data file called dump.rdb in the current working directory of wherever redis-server was executed from:

$ file -b dump.rdb

data

You can also manually invoke a save with the Redis command BGSAVE :

127.0.0.1:6379> BGSAVE

Background saving started

The “BG” in BGSAVE indicates that the save occurs in the background. This option is available in a redis-py method as well:

>>> r.lastsave() # Redis command: LASTSAVE

datetime.datetime(2019, 3, 10, 21, 56, 50)

>>> r.bgsave()

True

>>> r.lastsave()

datetime.datetime(2019, 3, 10, 22, 4, 2)

This example introduces another new command and method, .lastsave() . In Redis, it returns the Unix timestamp of the last DB save, which Python gives back to you as a datetime objeto. Above, you can see that the r.lastsave() result changes as a result of r.bgsave() .

r.lastsave() will also change if you enable automatic snapshotting with the save configuration option.

To rephrase all of this, there are two ways to enable snapshotting:

- Explicitly, through the Redis command

BGSAVEorredis-pymethod.bgsave() - Implicitly, through the

saveconfiguration option (which you can also set with.config_set()inredis-py)

RDB snapshotting is fast because the parent process uses the fork() system call to pass off the time-intensive write to disk to a child process, so that the parent process can continue on its way. This is what the background in BGSAVE refers to.

There’s also SAVE (.save() in redis-py ), but this does a synchronous (blocking) save rather than using fork() , so you shouldn’t use it without a specific reason.

Even though .bgsave() occurs in the background, it’s not without its costs. The time for fork() itself to occur can actually be substantial if the Redis database is large enough in the first place.

If this is a concern, or if you can’t afford to miss even a tiny slice of data lost due to the periodic nature of RDB snapshotting, then you should look into the append-only file (AOF) strategy that is an alternative to snapshotting. AOF copies Redis commands to disk in real time, allowing you to do a literal command-based reconstruction by replaying these commands.

Serialization Workarounds

Let’s get back to talking about Redis data structures. With its hash data structure, Redis in effect supports nesting one level deep:

127.0.0.1:6379> hset mykey field1 value1

The Python client equivalent would look like this:

r.hset("mykey", "field1", "value1")

Here, you can think of "field1": "value1" as being the key-value pair of a Python dict, {"field1": "value1"} , while mykey is the top-level key:

| Redis Command | Pure-Python Equivalent |

|---|---|

r.set("key", "value") | r = {"key": "value"} |

r.hset("key", "field", "value") | r = {"key": {"field": "value"}} |

But what if you want the value of this dictionary (the Redis hash) to contain something other than a string, such as a list or nested dictionary with strings as values?

Here’s an example using some JSON-like data to make the distinction clearer:

restaurant_484272 = {

"name": "Ravagh",

"type": "Persian",

"address": {

"street": {

"line1": "11 E 30th St",

"line2": "APT 1",

},

"city": "New York",

"state": "NY",

"zip": 10016,

}

}

Say that we want to set a Redis hash with the key 484272 and field-value pairs corresponding to the key-value pairs from restaurant_484272 . Redis does not support this directly, because restaurant_484272 is nested:

>>> r.hmset(484272, restaurant_484272)

Traceback (most recent call last):

# ...

redis.exceptions.DataError: Invalid input of type: 'dict'.

Convert to a byte, string or number first.

You can in fact make this work with Redis. There are two different ways to mimic nested data in redis-py and Redis:

- Serialize the values into a string with something like

json.dumps() - Use a delimiter in the key strings to mimic nesting in the values

Let’s take a look at an example of each.

Option 1:Serialize the Values Into a String

You can use json.dumps() to serialize the dict into a JSON-formatted string:

>>> import json

>>> r.set(484272, json.dumps(restaurant_484272))

True

If you call .get() , the value you get back will be a bytes object, so don’t forget to deserialize it to get back the original object. json.dumps() and json.loads() are inverses of each other, for serializing and deserializing data, respectively:

>>> from pprint import pprint

>>> pprint(json.loads(r.get(484272)))

{'address': {'city': 'New York',

'state': 'NY',

'street': '11 E 30th St',

'zip': 10016},

'name': 'Ravagh',

'type': 'Persian'}

This applies to any serialization protocol, with another common choice being yaml :

>>> import yaml # python -m pip install PyYAML

>>> yaml.dump(restaurant_484272)

'address: {city: New York, state: NY, street: 11 E 30th St, zip: 10016}\nname: Ravagh\ntype: Persian\n'

No matter what serialization protocol you choose to go with, the concept is the same:you’re taking an object that is unique to Python and converting it to a bytestring that is recognized and exchangeable across multiple languages.

Option 2:Use a Delimiter in Key Strings

There’s a second option that involves mimicking “nestedness” by concatenating multiple levels of keys in a Python dict . This consists of flattening the nested dictionary through recursion, so that each key is a concatenated string of keys, and the values are the deepest-nested values from the original dictionary. Consider our dictionary object restaurant_484272 :

restaurant_484272 = {

"name": "Ravagh",

"type": "Persian",

"address": {

"street": {

"line1": "11 E 30th St",

"line2": "APT 1",

},

"city": "New York",

"state": "NY",

"zip": 10016,

}

}

We want to get it into this form:

{

"484272:name": "Ravagh",

"484272:type": "Persian",

"484272:address:street:line1": "11 E 30th St",

"484272:address:street:line2": "APT 1",

"484272:address:city": "New York",

"484272:address:state": "NY",

"484272:address:zip": "10016",

}

That’s what setflat_skeys() below does, with the added feature that it does inplace .set() operations on the Redis instance itself rather than returning a copy of the input dictionary:

1from collections.abc import MutableMapping

2

3def setflat_skeys(

4 r: redis.Redis,

5 obj: dict,

6 prefix: str,

7 delim: str = ":",

8 *,

9 _autopfix=""

10) -> None:

11 """Flatten `obj` and set resulting field-value pairs into `r`.

12

13 Calls `.set()` to write to Redis instance inplace and returns None.

14

15 `prefix` is an optional str that prefixes all keys.

16 `delim` is the delimiter that separates the joined, flattened keys.

17 `_autopfix` is used in recursive calls to created de-nested keys.

18

19 The deepest-nested keys must be str, bytes, float, or int.

20 Otherwise a TypeError is raised.

21 """

22 allowed_vtypes = (str, bytes, float, int)

23 for key, value in obj.items():

24 key = _autopfix + key

25 if isinstance(value, allowed_vtypes):

26 r.set(f"{prefix}{delim}{key}", value)

27 elif isinstance(value, MutableMapping):

28 setflat_skeys(

29 r, value, prefix, delim, _autopfix=f"{key}{delim}"

30 )

31 else:

32 raise TypeError(f"Unsupported value type: {type(value)}")

The function iterates over the key-value pairs of obj , first checking the type of the value (Line 25) to see if it looks like it should stop recursing further and set that key-value pair. Otherwise, if the value looks like a dict (Line 27), then it recurses into that mapping, adding the previously seen keys as a key prefix (Line 28).

Let’s see it at work:

>>>>>> r.flushdb() # Flush database: clear old entries

>>> setflat_skeys(r, restaurant_484272, 484272)

>>> for key in sorted(r.keys("484272*")): # Filter to this pattern

... print(f"{repr(key):35}{repr(r.get(key)):15}")

...

b'484272:address:city' b'New York'

b'484272:address:state' b'NY'

b'484272:address:street:line1' b'11 E 30th St'

b'484272:address:street:line2' b'APT 1'

b'484272:address:zip' b'10016'

b'484272:name' b'Ravagh'

b'484272:type' b'Persian'

>>> r.get("484272:address:street:line1")

b'11 E 30th St'

The final loop above uses r.keys("484272*") , where "484272*" is interpreted as a pattern and matches all keys in the database that begin with "484272" .

Notice also how setflat_skeys() calls just .set() rather than .hset() , because we’re working with plain string:string field-value pairs, and the 484272 ID key is prepended to each field string.

Encryption

Another trick to help you sleep well at night is to add symmetric encryption before sending anything to a Redis server. Consider this as an add-on to the security that you should make sure is in place by setting proper values in your Redis configuration. The example below uses the cryptography package:

$ python -m pip install cryptography

To illustrate, pretend that you have some sensitive cardholder data (CD) that you never want to have sitting around in plaintext on any server, no matter what. Before caching it in Redis, you can serialize the data and then encrypt the serialized string using Fernet:

>>>>>> import json

>>> from cryptography.fernet import Fernet

>>> cipher = Fernet(Fernet.generate_key())

>>> info = {

... "cardnum": 2211849528391929,

... "exp": [2020, 9],

... "cv2": 842,

... }

>>> r.set(

... "user:1000",

... cipher.encrypt(json.dumps(info).encode("utf-8"))

... )

>>> r.get("user:1000")

b'gAAAAABcg8-LfQw9TeFZ1eXbi' # ... [truncated]

>>> cipher.decrypt(r.get("user:1000"))

b'{"cardnum": 2211849528391929, "exp": [2020, 9], "cv2": 842}'

>>> json.loads(cipher.decrypt(r.get("user:1000")))

{'cardnum': 2211849528391929, 'exp': [2020, 9], 'cv2': 842}

Because info contains a value that is a list , you’ll need to serialize this into a string that’s acceptable by Redis. (You could use json , yaml , or any other serialization for this.) Next, you encrypt and decrypt that string using the cipher objeto. You need to deserialize the decrypted bytes using json.loads() so that you can get the result back into the type of your initial input, a dict .

Note :Fernet uses AES 128 encryption in CBC mode. See the cryptography docs for an example of using AES 256. Whatever you choose to do, use cryptography , not pycrypto (imported as Crypto ), which is no longer actively maintained.

If security is paramount, encrypting strings before they make their way across a network connection is never a bad idea.

Compression

One last quick optimization is compression. If bandwidth is a concern or you’re cost-conscious, you can implement a lossless compression and decompression scheme when you send and receive data from Redis. Here’s an example using the bzip2 compression algorithm, which in this extreme case cuts down on the number of bytes sent across the connection by a factor of over 2,000:

>>> 1>>> import bz2

2

3>>> blob = "i have a lot to talk about" * 10000

4>>> len(blob.encode("utf-8"))

5260000

6

7>>> # Set the compressed string as value

8>>> r.set("msg:500", bz2.compress(blob.encode("utf-8")))

9>>> r.get("msg:500")

10b'BZh91AY&SY\xdaM\x1eu\x01\x11o\x91\x80@\x002l\x87\' # ... [truncated]

11>>> len(r.get("msg:500"))

12122

13>>> 260_000 / 122 # Magnitude of savings

142131.1475409836066

15

16>>> # Get and decompress the value, then confirm it's equal to the original

17>>> rblob = bz2.decompress(r.get("msg:500")).decode("utf-8")

18>>> rblob == blob

19True

The way that serialization, encryption, and compression are related here is that they all occur client-side. You do some operation on the original object on the client-side that ends up making more efficient use of Redis once you send the string over to the server. The inverse operation then happens again on the client side when you request whatever it was that you sent to the server in the first place.

Using Hiredis

It’s common for a client library such as redis-py to follow a protocol in how it is built. In this case, redis-py implements the REdis Serialization Protocol, or RESP.

Part of fulfilling this protocol consists of converting some Python object in a raw bytestring, sending it to the Redis server, and parsing the response back into an intelligible Python object.

For example, the string response “OK” would come back as "+OK\r\n" , while the integer response 1000 would come back as ":1000\r\n" . This can get more complex with other data types such as RESP arrays.

A parser is a tool in the request-response cycle that interprets this raw response and crafts it into something recognizable to the client. redis-py ships with its own parser class, PythonParser , which does the parsing in pure Python. (See .read_response() if you’re curious.)

However, there’s also a C library, Hiredis, that contains a fast parser that can offer significant speedups for some Redis commands such as LRANGE . You can think of Hiredis as an optional accelerator that it doesn’t hurt to have around in niche cases.

All that you have to do to enable redis-py to use the Hiredis parser is to install its Python bindings in the same environment as redis-py :

$ python -m pip install hiredis

What you’re actually installing here is hiredis-py , which is a Python wrapper for a portion of the hiredis C library.

The nice thing is that you don’t really need to call hiredis tú mismo. Just pip install it, and this will let redis-py see that it’s available and use its HiredisParser instead of PythonParser .

Internally, redis-py will attempt to import hiredis , and use a HiredisParser class to match it, but will fall back to its PythonParser instead, which may be slower in some cases:

# redis/utils.py

try:

import hiredis

HIREDIS_AVAILABLE = True

except ImportError:

HIREDIS_AVAILABLE = False

# redis/connection.py

if HIREDIS_AVAILABLE:

DefaultParser = HiredisParser

else:

DefaultParser = PythonParser

Using Enterprise Redis Applications

While Redis itself is open-source and free, several managed services have sprung up that offer a data store with Redis as the core and some additional features built on top of the open-source Redis server:

-

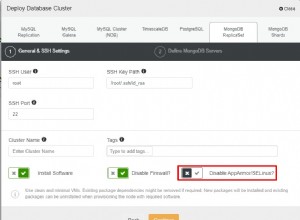

Amazon ElastiCache for Redis : This is a web service that lets you host a Redis server in the cloud, which you can connect to from an Amazon EC2 instance. For full setup instructions, you can walk through Amazon’s ElastiCache for Redis launch page.

-

Microsoft’s Azure Cache for Redis : This is another capable enterprise-grade service that lets you set up a customizable, secure Redis instance in the cloud.

The designs of the two have some commonalities. You typically specify a custom name for your cache, which is embedded as part of a DNS name, such as demo.abcdef.xz.0009.use1.cache.amazonaws.com (AWS) or demo.redis.cache.windows.net (Azure).

Once you’re set up, here are a few quick tips on how to connect.

From the command line, it’s largely the same as in our earlier examples, but you’ll need to specify a host with the h flag rather than using the default localhost. For Amazon AWS , execute the following from your instance shell:

$ export REDIS_ENDPOINT="demo.abcdef.xz.0009.use1.cache.amazonaws.com"

$ redis-cli -h $REDIS_ENDPOINT

For Microsoft Azure , you can use a similar call. Azure Cache for Redis uses SSL (port 6380) by default rather than port 6379, allowing for encrypted communication to and from Redis, which can’t be said of TCP. All that you’ll need to supply in addition is a non-default port and access key:

$ export REDIS_ENDPOINT="demo.redis.cache.windows.net"

$ redis-cli -h $REDIS_ENDPOINT -p 6380 -a <primary-access-key>

The -h flag specifies a host, which as you’ve seen is 127.0.0.1 (localhost) by default.

When you’re using redis-py in Python, it’s always a good idea to keep sensitive variables out of Python scripts themselves, and to be careful about what read and write permissions you afford those files. The Python version would look like this:

>>> import os

>>> import redis

>>> # Specify a DNS endpoint instead of the default localhost

>>> os.environ["REDIS_ENDPOINT"]

'demo.abcdef.xz.0009.use1.cache.amazonaws.com'

>>> r = redis.Redis(host=os.environ["REDIS_ENDPOINT"])

Eso es todo al respecto. Besides specifying a different host , you can now call command-related methods such as r.get() as normal.

Note :If you want to use solely the combination of redis-py and an AWS or Azure Redis instance, then you don’t really need to install and make Redis itself locally on your machine, since you don’t need either redis-cli or redis-server .

If you’re deploying a medium- to large-scale production application where Redis plays a key role, then going with AWS or Azure’s service solutions can be a scalable, cost-effective, and security-conscious way to operate.

Wrapping Up

That concludes our whirlwind tour of accessing Redis through Python, including installing and using the Redis REPL connected to a Redis server and using redis-py in real-life examples. Here’s some of what you learned:

redis-pylets you do (almost) everything that you can do with the Redis CLI through an intuitive Python API.- Mastering topics such as persistence, serialization, encryption, and compression lets you use Redis to its full potential.

- Redis transactions and pipelines are essential parts of the library in more complex situations.

- Enterprise-level Redis services can help you smoothly use Redis in production.

Redis has an extensive set of features, some of which we didn’t really get to cover here, including server-side Lua scripting, sharding, and master-slave replication. If you think that Redis is up your alley, then make sure to follow developments as it implements an updated protocol, RESP3.

Further Reading

Here are some resources that you can check out to learn more.

Books:

- Josiah Carlson: Redis in Action

- Karl Seguin: The Little Redis Book

- Luc Perkins et. al.: Seven Databases in Seven Weeks

Redis in use:

- Twitter: Real-Time Delivery Architecture at Twitter

- Spool: Redis bitmaps – Fast, easy, realtime metrics

- 3scale: Having fun with Redis Replication between Amazon and Rackspace

- Instagram: Storing hundreds of millions of simple key-value pairs in Redis

- Craigslist: Redis Sharding at Craigslist

- Disqus: Redis at Disqus

Other:

- Digital Ocean: How To Secure Your Redis Installation

- AWS: ElastiCache for Redis User Guide

- Microsoft: Azure Cache for Redis

- Cheatography: Redis Cheat Sheet

- ClassDojo: Better Rate Limiting With Redis Sorted Sets

- antirez (Salvatore Sanfilippo): Redis persistence demystified

- Martin Kleppmann: How to do distributed locking

- HighScalability: 11 Common Web Use Cases Solved in Redis